从单张运动模糊图像中估计相机运动:Image as an IMU

Image as an IMU:从单张运动模糊图像中估计相机运动

Jerred Chen, Ronald Clark University of Oxford arXiv 2025 Paper Supplementary Code (即将推出) arXiv

给定单张运动模糊图像,我们利用运动模糊线索来预测该时刻的相机速度,无需执行任何去模糊操作。

Abstract

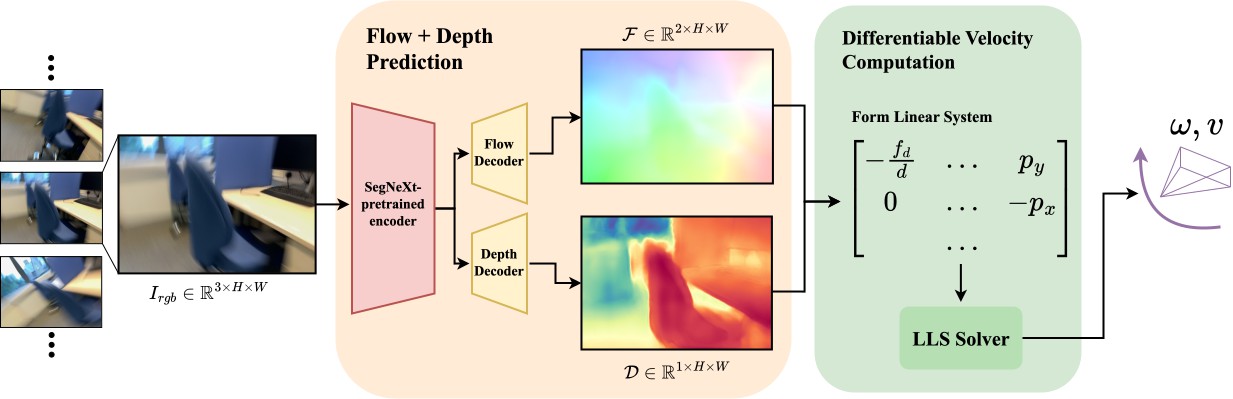

在许多机器人和 VR/AR 应用中,快速的相机运动会导致高度的运动模糊,导致现有的相机姿态估计方法失效。 在这项工作中,我们提出了一种新颖的框架,该框架将运动模糊视为运动估计的丰富线索,而不是将其视为不需要的伪影。 我们的方法通过直接从单张运动模糊图像中预测密集运动流场和单目深度图来实现。 然后,我们在小运动假设下通过求解线性最小二乘问题来恢复瞬时相机速度。 本质上,我们的方法产生类似 IMU 的测量,可以鲁棒地捕获快速且剧烈的相机运动。 为了训练我们的模型,我们构建了一个具有逼真的合成运动模糊的大规模数据集,该数据集源自 ScanNet++v2,并通过使用我们完全可微的流水线在真实数据上进行端到端训练来进一步改进我们的模型。 在真实世界基准上的广泛评估表明,我们的方法实现了最先进的角度和转换速度估计,优于当前的方法,如 MASt3R 和 COLMAP。

Motivation

相机运动的一个常见假设是,每张图像代表时间上的一个单一瞬时快照。 然而,在现实中,相机在整个曝光时间内经历连续运动,这会在快速运动下产生运动模糊。 虽然这对于标准的姿态估计方法来说可能有问题,但我们的目标是利用运动模糊伪影作为丰富的信息来源,以帮助估计运动。

Method Overview

给定单张图像,我们的方法会预测密集运动流场和单目深度图。 然后,我们使用已知的曝光时间和相机内参,通过线性最小二乘法恢复瞬时相机速度。 为了消除视频中速度方向的歧义,我们使用预测的运动来计算当前帧和前/后帧之间的光度误差,并在必要时翻转方向。

Evaluation Setup

我们使用 iPhone 13 Pro 上的 StrayScanner app 中记录的素材进行所有评估。 该 app 经过略微修改,可以从 ARKit 获取曝光时间。

Experimental Results

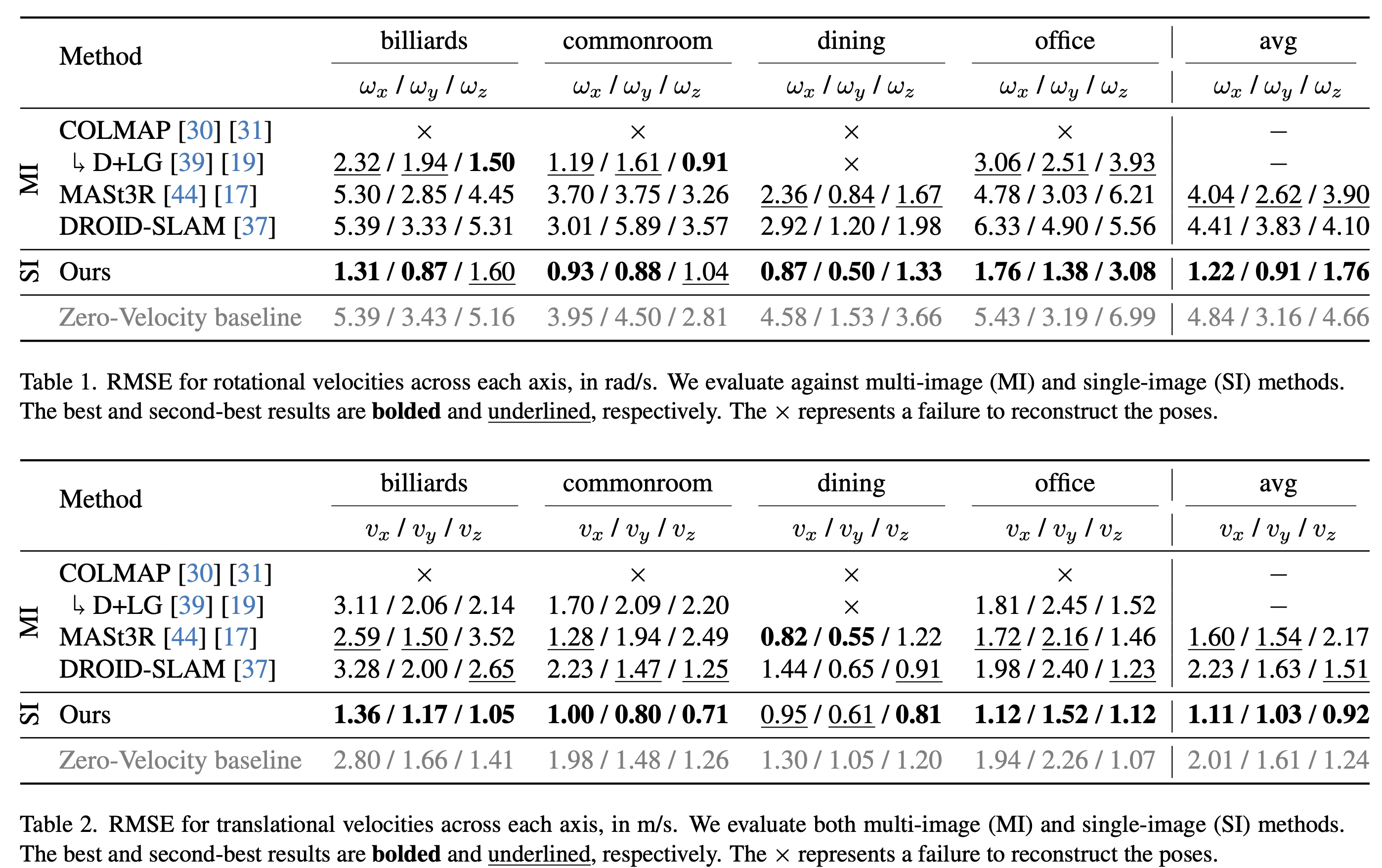

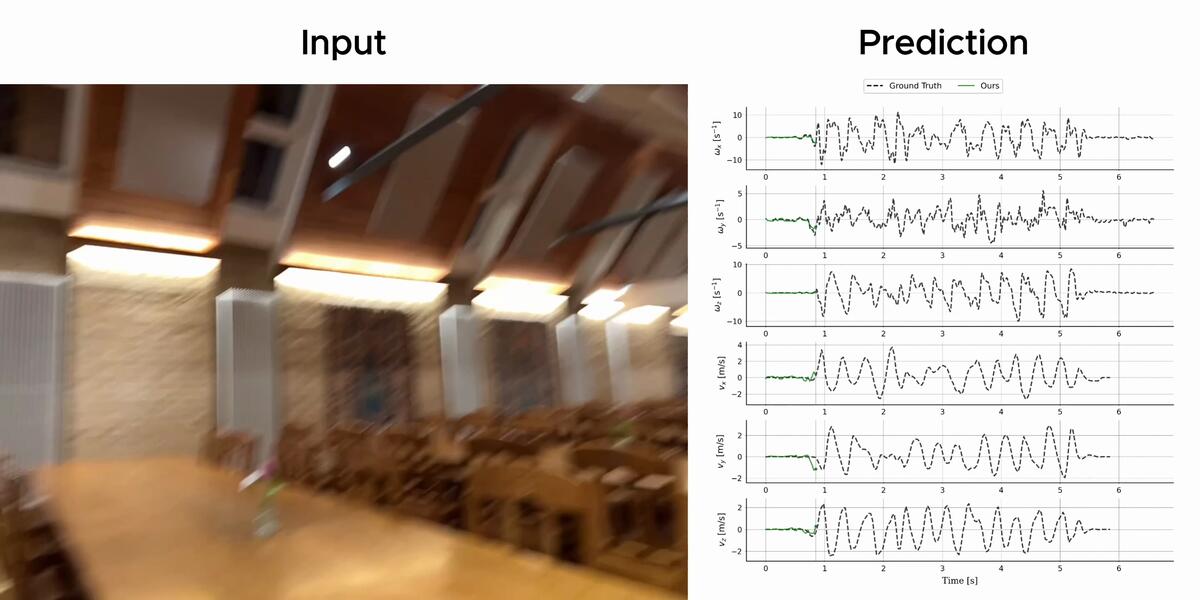

我们在真实世界的运动模糊视频上评估了我们的方法。 虽然基线方法必须使用多帧来计算速度,但我们的网络仅采用_单帧_作为输入。 由于单张运动模糊图像的真实方向是模糊的,因此我们根据帧之间的光度误差在必要时翻转速度方向。 我们直接将陀螺仪读数视为角速度的真值,并使用 ARKit 姿势和帧速率来近似转换速度的真值。 请注意,角速度轴为 x 向上、y 向左、z 向后(使用 IMU 约定),而转换速度轴为 x 向右、y 向下、z 向前(使用 OpenCV 约定)。

回放速度:0.25x

Quantitative Results

Frame-by-Frame Inference

我们的网络使用单帧作为输入,完全独立于视频的其余部分。 尝试滑动滑块,看看我们的方法如何在特定帧恢复相机运动!

Runtime Comparison

我们展示了我们的方法与基线方法在真实世界视频之一上的运行时间。 所有方法都在 Nvidia RTX 3090 上运行。 即使包括方向消除歧义,我们的方法也明显更快,并且可以以 30 Hz 的速度实时运行。

BibTeX

@article{chen2025_imageimu,

title = {{Image as an IMU}: Estimating Camera Motion from a Single Motion-Blurred Image},

author = {Chen, Jerred and Clark, Ronald},

journal = {arXiv preprint},

year = {2025}

}

此页面是使用 Academic Project Page Template 构建的,该模板是从 Nerfies 项目页面采用的。 本网站已获得 Creative Commons Attribution-ShareAlike 4.0 International License 的许可。