Kagi Assistant 现已面向所有用户开放

Tales from Kagi Home Blog

Kagi Assistant 现已面向所有用户开放!

_ 2025年4月17日 _

在 Kagi,我们的使命很简单:使网络人性化。我们希望提供一种以人为本的搜索体验,让您能够有效、私密且不受操纵地探索网络。我们评估新技术,不是因为它们的名声,而是因为它们在支持我们的使命方面的真正潜力。

在 Kagi,我们的使命很简单:使网络人性化。我们希望提供一种以人为本的搜索体验,让您能够有效、私密且不受操纵地探索网络。我们评估新技术,不是因为它们的名声,而是因为它们在支持我们的使命方面的真正潜力。

自推出以来,Kagi Assistant 一直是许多用户的最爱,因为它允许在一个美观的用户界面中访问世界顶级的大型语言模型,并基于 Kagi Search,而且这一切都只需要在我们的 Professional 计划基础上每月升级 +$15,即可享受无限制的 Kagi Search。

今天,我们很高兴地宣布,Kagi Assistant 现已面向所有计划的用户开放,从之前仅限 Ultimate 订阅者扩展到所有 Kagi 客户,作为一项附加价值,且不增加价格。

重要提示: 我们正在分阶段为所有用户启用 Assistant,首先从美国开始。计划于 UTC 时间 23:59(星期日)之前完成“面向所有人开放 Assistant”的全面推广。

我们整合 AI 的方法 受这些现实情况的影响,并遵循三个原则:

- AI 服务于明确的、与搜索相关的上下文:Kagi Assistant 是一种研究辅助工具。

- AI 增强,而不是取代:Kagi Search 仍然是我们的核心产品,独立运作。Kagi Assistant 是一个您可以根据需要使用的可选工具。

- AI 应该增强人性,而不是削弱它:我们的目标是通过帮助您综合信息或探索基于 Kagi Search 结果的主题来改善您的研究过程,而不是取代您的批判性思维。

Kagi Assistant 体现了这些原则,在 Kagi 搜索结果的上下文中工作,提供了一种与信息交互的新方式。它的构建旨在使研究更容易,同时尊重您的隐私和 AI 的限制。

通过向所有人提供 Kagi Assistant,我们让所有用户可以选择将此功能作为 Kagi 工具包的一部分进行探索——无需为订阅支付额外费用。您可以根据自己的工作流程随时随地使用它,因为它以隐私、责任和以人为本的价值观为核心构建。

让我们来谈谈具体细节!

AI 基于 Kagi Search,由您指导

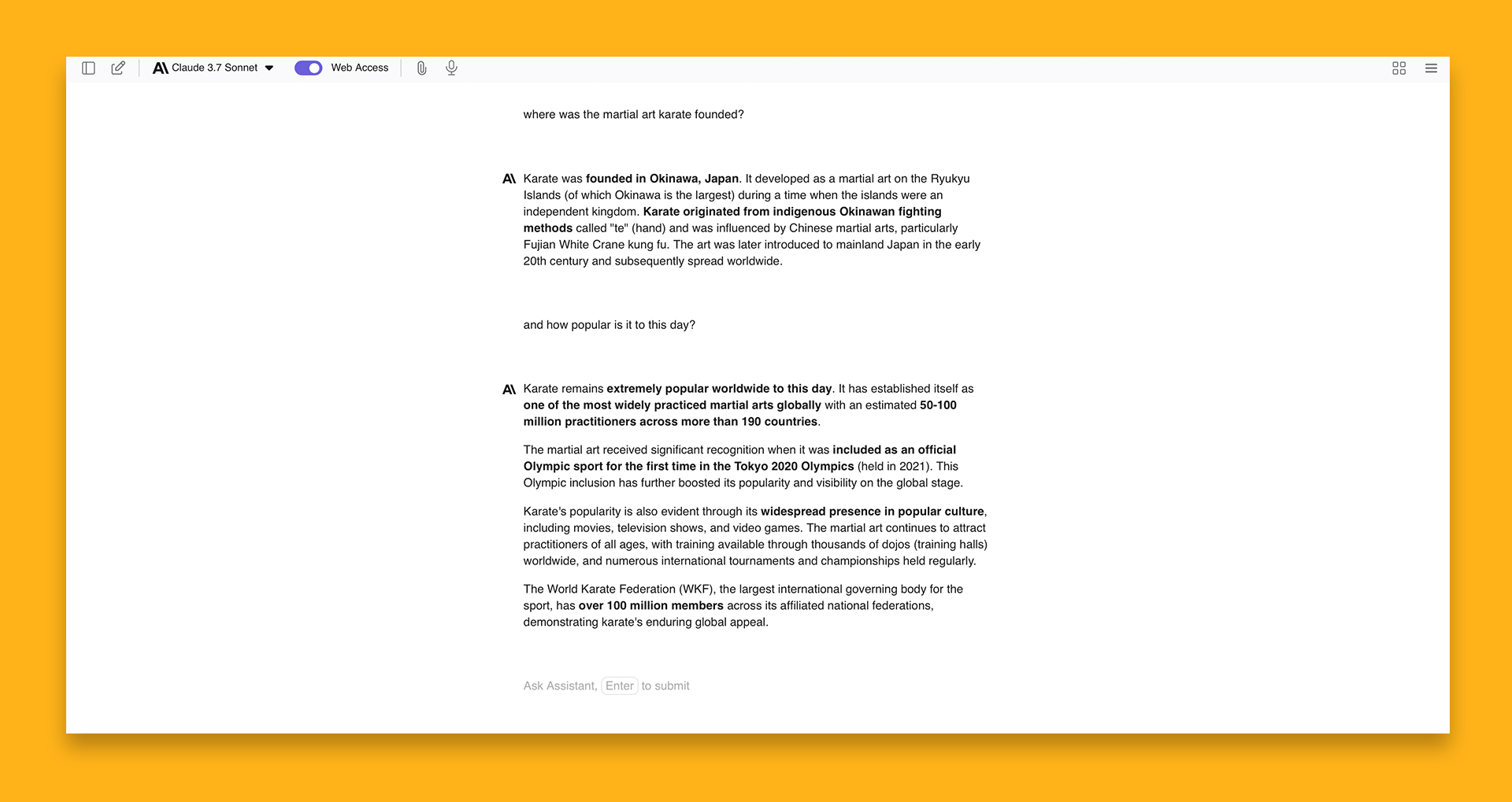

当您启用 Web 访问时,Assistant 可以访问 Kagi Search 结果。它还将尊重您的个性化域名排名,并允许使用 Lenses 来缩小搜索范围。

或者,如果您更喜欢直接与模型讨论,您也可以关闭 Web 访问。它还支持文件上传,允许您为查询提供额外的上下文或信息。

根据您的需求定制的自定义助手

创建具有独特指令的专用助手,定义其目的、上下文和 Web 访问偏好。需要帮助进行编码、语法审查或诊断您的经典 VW Bus 的问题?为此构建一个助手。

专业提示:分配一个自定义 bang (!name),以便通过浏览器的搜索栏立即访问。

通过编辑进行改进和重定向

对话并不总是按计划进行。如果响应未达到预期,Kagi Assistant 允许您编辑提示、切换模型或在线程中间调整设置。这确保您保持控制,并且可以在不重新开始的情况下重定向对话。

隐私是基础

您的隐私是我们的首要任务。Assistant 线程默认是私有的,会根据您的设置自动过期,并且您的交互数据不会用于训练 AI 模型。这适用于 Kagi 和第三方提供商,并受到严格的合同条款约束。

有关更多信息,请参阅 Kagi LLMs privacy。

关于我们的合理使用政策的说明

提供强大的 AI 工具需要大量资源。为确保可持续性,我们开始执行我们的合理使用政策。

基本上,我们的政策规定,您可以根据您的计划价值使用 AI 模型。例如,每月 25 美元的计划允许在所有模型中使用价值高达 25 美元的原始 token 成本(我们保留 20% 的内置保证金,用于提供搜索、服务开发和基础设施)。从我们的 token 使用统计数据来看,95% 的用户永远不会达到此限制。

虽然大多数用户不会受到影响,但那些超过慷慨阈值的用户可以立即续订他们的订阅周期。很快,我们将推出信用充值以增加灵活性。与其他服务中发现的任意使用限制相比,这种方法确保了公平的、用户资助的模型,同时保持了高质量的服务,并且是一种简单的使用控制方式。

您最喜欢的模型正在等待着您

从来自 OpenAI、Anthropic、Google、Mistral 等公司的各种领先 LLM 中进行选择。您可以在线程中间切换模型,并通过我们定期更新的 开源 LLM 基准测试 探索它们的性能。非 Ultimate 计划中的模型选择将受到限制,无法与我们在 Ultimate 计划中提供的完整产品相比,请参阅下文。

访问您最喜欢的 LLM 可以使 Kagi Assistant 适应您的需求和查询自定义,因此我们提供了一系列模型供您选择。

模型名称 | 计划 ---|--- GPT 4o mini | 所有 GPT 4.1 mini | 所有 GPT 4.1 nano | 所有 Gemini 2.5 Flash | 所有 Mistral Pixtral | 所有 Llama 3.3 70B | 所有 Llama 4 Scout | 所有 Llama 4 Maverick | 所有 Nova Lite | 所有 DeepSeek Chat V3 | 所有 GPT 4o | Ultimate o3 mini | Ultimate o4 mini | Ultimate GPT 4.1 | Ultimate ChatGPT 4o | Ultimate Grok 3 | Ultimate Grok 3 Mini | Ultimate Claude 3.5 Haiku | Ultimate Claude 3.7 Sonnet | Ultimate Claude 3.7 Sonnet with extended thinking | Ultimate Claude 3 Opus | Ultimate Gemini 1.5 Pro | Ultimate Gemini 2.5 Pro Preview | Ultimate Mistral Large | Ultimate Llama 3.1 405B | Ultimate Qwen QwQ 32B | Ultimate Nova Pro | Ultimate DeepSeek R1 | Ultimate DeepSeek R1 Distill Llama 70B | Ultimate

进一步探索

这仅仅是 Kagi Assistant 的开始。在我们的 文档 中探索更多内容。

快乐检索,Kagi 团队。

F.A.Q.

问:与较大的模型相比,使用成本较低的模型(如 DeepSeek)是否会减少信用消耗? 答: 是的。合理使用政策根据模型提供商收取的实际成本计算使用量。因此,与较大的模型相比,使用较小、成本较低的模型将允许更多的 token 使用量。

问:Kagi 是否从 AI 模型提供商那里获得折扣价? 答: 不,Kagi 没有获得折扣。但是,我们利用智能缓存技术来降低运营成本,并将这些节省转嫁给用户。

问:Kagi 为什么开始执行合理使用政策? 答: 由于过度使用,该政策得以执行。例如,前 10 名用户约占总成本的 14%,其中一些人每周在最先进的模型上持续使用高达 5000 万个 token。我们的利润率已经非常低了。95% 的用户永远不会达到任何使用限制。

问:具体使用限制是多少? 答: 该限制与您的 Kagi 计划的货币价值直接对应,转换为等效的 token 数量。例如,25 美元的计划提供价值 25 美元的 token 使用量。此计算包括 20% 的 Kagi 保证金,用于支付搜索提供、开发和基础设施成本。通过提示缓存和其他优化实现的节省将传递给您。

问:在哪里可以查看我的 token 使用量? 答: 目前,您可以在“消耗”页面上监控您的 token 使用量:https://kagi.com/settings?p=consumption。我们计划很快更显眼地显示成本和交互详细信息,可能在账单页面上或直接在 Assistant 界面中。

问:我无法访问 Assistant! 答: 我们正在分阶段推出,首先从美国开始,计划在 UTC 时间周日 23:59 完成全面推出。这将包括其他地区,甚至包括试用计划。